如何巧用robots避免蜘蛛黑洞?

2021-02-03 分類: 網站建設

對于百度搜索引擎來說,蜘蛛黑洞特指網站通過極低的成本制造出大量參數過多,及內容雷同但具體參數不同的動態URL ,就像一個無限循環的“黑洞”將spider困住,Baiduspider浪費了大量資源抓取的卻是無效網頁。

比如很多網站都有篩選功能,通過篩選功能產生的網頁經常會被搜索引擎大量抓取,而這其中很大一部分檢索價值不高,如“500-1000之間價格的租房”,首先網站(包括現實中)上基本沒有相關資源,其次站內用戶和搜索引擎用戶都沒有這種檢索習慣。這種網頁被搜索引擎大量抓取,只能是占用網站寶貴的抓取配額。那么該如何避免這種情況呢?

我們以北京某團購網站為例,看看該網站是如何利用robots巧妙避免這種蜘蛛黑洞的:

對于普通的篩選結果頁,該網站選擇使用靜態鏈接,如:http://bj.XXXXX.com/category/zizhucan/weigongcun

同樣是條件篩選結果頁,當用戶選擇不同排序條件后,會生成帶有不同參數的動態鏈接,而且即使是同一種排序條件(如:都是按銷量降序排列),生成的參數也都是不同的。如:http://bj.XXXXX.com/category/zizhucan/weigongcun/hot?mtt=1.index%2Fpoi.0.0.i1afqhek

http://bj.XXXXX.com/category/zizhucan/weigongcun/hot?mtt=1.index%2Fpoi.0.0.i1afqi5c

對于該團購網來說,只讓搜索引擎抓取篩選結果頁就可以了,而各種帶參數的結果排序頁面則通過robots規則拒絕提供給搜索引擎。

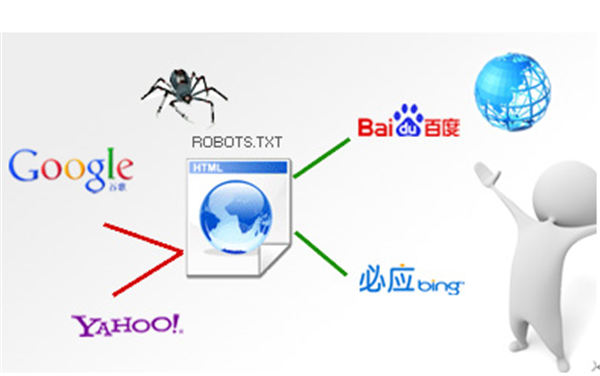

robots.txt的文件用法中有這樣一條規則:Disallow: /*?* ,即禁止搜索引擎訪問網站中所有的動態頁面。該網站恰是通過這種方式,對Baiduspider優先展示高質量頁面、屏蔽了低質量頁面,為Baiduspider提供了更友好的網站結構,避免了黑洞的形成。

新聞標題:如何巧用robots避免蜘蛛黑洞?

標題路徑:http://m.newbst.com/news/98973.html

成都網站建設公司_創新互聯,為您提供品牌網站設計、云服務器、虛擬主機、電子商務、全網營銷推廣、企業建站

聲明:本網站發布的內容(圖片、視頻和文字)以用戶投稿、用戶轉載內容為主,如果涉及侵權請盡快告知,我們將會在第一時間刪除。文章觀點不代表本網站立場,如需處理請聯系客服。電話:028-86922220;郵箱:631063699@qq.com。內容未經允許不得轉載,或轉載時需注明來源: 創新互聯

猜你還喜歡下面的內容

- 適用于Vue開發人員的原型工具OverVue 2021-02-03

- 為什么程序員的業余項目大多都死了? 2021-02-03

- H5嵌入APP的聯合登錄 2021-02-03

- 教育培訓機構4個好用的招生營銷模式 2021-02-03

- 高DAU產品的6大運營絕招,輕松達成95%留存率! 2021-02-03

- 新零售時代已來,助力社區商業實現智能化、數據化 2021-02-03

- 炒域名還有“錢”途嗎? 2021-02-03

- 智能家居離不開云計算 2021-02-03

- 網賺建站第一步:域名申請 2021-02-03

- 互聯網時代,用內容營銷為企業賦能 2021-02-03

- 什么是云計算,一起了解一下 2021-02-03

- 購買還是自建?企業應該怎樣選擇數據科學平臺? 2021-02-03

- 8個步驟教你搞定網站運營 2021-02-03

- 方向錯誤,人工智能可能演變成一場泡沫 2021-02-03

- 區塊鏈技術和物聯網技術將締造一個新時代 2021-02-03

- 微信這免費又實用的五個小程序,第二個還能幫人脫單 2021-02-03

- 永遠不要與趨勢為敵,未來它才是關鍵 2021-02-03

- B2C和B2B的區別對企業布局互聯網的意義? 2021-02-03

- 小程序怎么制作 2021-02-03